В статье представлен опыт изучения нейронных сетей, их реализации с помощью языка программирования Java. Определен терминологический аппарат работы с нейросетями, их свойства и функции.

Ключевые слова: нейрон, синапс, нейронная сеть, функция активации, линейная функция, сигмоид, гиперболический тангенс, тренировочный сет

В этой статье хотелось бы поделиться опытом в изучении нейронных сетей и, как следствие, их реализации, с помощью языка программирования Java, на платформе Android. Первое знакомство с нейронными сетями произошло, когда появилось приложение Prisma. Оно обрабатывает любую фотографию, с помощью нейронных сетей, и воспроизводит ее с нуля, используя выбранный стиль. На удивление, нет ни одной статьи, которая четко и поэтапно расписывает алгоритм работы нейронных сетей. Информация полностью разрознена, отсутствуют ключевые моменты. Большинство авторов показывать только код на том или ином языке программирования, не прибегая к детальным объяснениям.

Первым и самым важным моим открытием был плейлист американского программиста Джеффа Хитона, в котором он подробно и наглядно разбирает принципы работы нейронных сетей и их классификации. После просмотра этого плейлиста, я решил создать свою нейронную сеть, начав с самого простого примера. Вам наверняка известно, что когда ты только начинаешь учить новый язык, первой твоей программой будет Hello World. В мире машинного обучения тоже есть свой Hello world — нейросеть, решающая проблему «исключающего или» (XOR) [6, 7, 8]. Таблица «исключающего или» выглядит следующим образом:

|

a |

b |

c |

|

0 |

0 |

0 |

|

0 |

1 |

1 |

|

1 |

0 |

1 |

|

1 |

1 |

0 |

Нейронная сеть берет на вход два числа и должна на выходе дать другое число — ответ. Теперь о самих нейронных сетях.

Что такое нейронная сеть?

Нейронная сеть— это последовательность нейронов, соединенных между собой синапсами [2]. Структура нейронной сети пришла в мир программирования из биологии. Благодаря такой структуре, машина обретает способность анализировать и даже запоминать различную информацию. Нейронные сети способны воспроизводить информацию из своей памяти. Другими словами, нейросеть — это машинная интерпретация мозга человека, в котором находятся миллионы нейронов передающих информацию в виде электрических импульсов [4, 5].

Будем рассматривать примеры на самом базовом типе нейронных сетей — сети прямого распространения (далее СПР). СПР — это сеть с последовательным соединением нейронных слоев, в ней информация идет только в одном направлении.

Нейронные сети используются для решения сложных задач, которые требуют аналитических вычислений подобных тем, что делает человеческий мозг [4]. Самыми распространенными применениями нейронных сетей является:

‒ Классификация — распределение данных по параметрам. Например, на вход дается набор людей и нужно решить, кому из них давать кредит, а кому нет. Эту работу может сделать нейронная сеть, анализируя такую информацию как: возраст, платежеспособность, кредитная история и т. д.

‒ Предсказание — возможность предсказывать следующий шаг. Например, рост или падение акций, основываясь на ситуации на фондовом рынке.

‒ Распознавание — в настоящее время, самое широкое применение нейронных сетей. Используется в Google, когда вы ищете фото или в камерах телефонов, когда оно определяет положение вашего лица и выделяет его и многое другое. Теперь, чтобы понять, как работают нейронные сети, давайте взглянем на их составляющие и параметры.

Что такое нейрон?

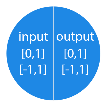

Нейрон— это вычислительная единица, которая получает информацию, производит над ней простые вычисления и передает ее дальше. Они делятся на три основных типа: входной (синий), скрытый (красный) и выходной (зеленый) [5]. Также есть нейрон смещения и контекстный нейрон о которых мы поговорим в следующей статье. В том случае, когда нейросеть состоит из большого количества нейронов, вводят термин слоя. Соответственно, есть входной слой, который получает информацию, n скрытых слоев (обычно их не больше 3), которые ее обрабатывают и выходной слой, который выводит результат. У каждого из нейронов есть 2 основных параметра: входные данные (input data) и выходные данные (output data). В случае входного нейрона: input=output. В остальных, в поле input попадает суммарная информация всех нейронов с предыдущего слоя, после чего, она нормализуется, с помощью функции активации (представим ее f(x)) и попадает в поле output.

Важно помнить, что нейроны оперируют числами в диапазоне [0,1] или [-1,1]. Вы спросите, как обрабатывать числа, которые выходят из данного диапазона? На данном этапе, самый простой ответ — это разделить 1 на это число. Этот процесс называется нормализацией, и он очень часто используется в нейронных сетях [6].

Что такое синапс?

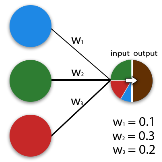

Синапс— это связь между двумя нейронами. У синапсов есть 1 параметр — вес. Благодаря ему, входная информация изменяется, когда передается от одного нейрона к другому. Допустим, есть 3 нейрона, которые передают информацию следующему. Тогда у нас есть 3 веса, соответствующие каждому из этих нейронов. У того нейрона, у которого вес будет больше, та информация и будет доминирующей в следующем нейроне (пример — смешение цветов). На самом деле, совокупность весов нейронной сети или матрица весов — это своеобразный мозг всей системы. Именно благодаря этим весам, входная информация обрабатывается и превращается в результат. Важно помнить, что во время инициализации нейронной сети, веса расставляются в случайном порядке.

Как работает нейронная сеть?

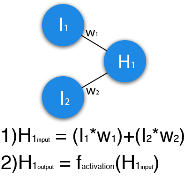

В данном примере изображена часть нейронной сети, где буквами I обозначены входные нейроны, буквой H — скрытый нейрон, а буквой w — веса. Из формулы видно, что входная информация — это сумма всех входных данных, умноженных на соответствующие им веса. Тогда дадим на вход 1 и 0. Пусть w1=0.4 и w2 = 0.7 Входные данные нейрона Н1 будут следующими: 1*0.4+0*0.7=0.4. Теперь, когда у нас есть входные данные, мы можем получить выходные данные, подставив входное значение в функцию активации (подробнее о ней далее). Выходные данные передаем дальше. Так мы повторяем для всех слоев, пока не дойдем до выходного нейрона. Запустив такую сеть в первый раз увидим, что ответ далек от правильно, потому что сеть не натренирована. Чтобы улучшить результаты мы будем ее тренировать. Давайте введем несколько терминов для описания свойств нейронной сети.

Функция активации— это способ нормализации входных данных [2]. То есть, если на входе у вас будет большое число, пропустив его через функцию активации, вы получите выход в нужном вам диапазоне. Функций активации достаточно много поэтому мы рассмотрим самые основные: Линейная, Сигмоид и Гиперболический тангенс. Главные их отличия — это диапазон значений.

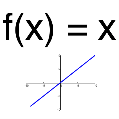

Линейная функция

Эта функция почти никогда не используется, за исключением случаев, когда нужно протестировать нейронную сеть или передать значение без преобразований.

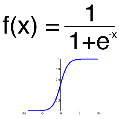

Сигмоид

Это самая распространенная функция активации, ее диапазон значений [0,1]. Именно на ней показано большинство примеров в сети, также ее иногда называют логической функцией [1]. Соответственно, если в вашем случае присутствуют отрицательные значения (например, в банковском секторе котировка акций может идти не только вверх, но и вниз), то вам понадобиться функция, которая захватывает и отрицательные значения.

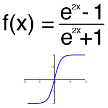

Гиперболический тангенс

Имеет смысл использовать гиперболический тангенс, только тогда, когда ваши значения могут быть и отрицательными, и положительными, так как диапазон функции [-1,1]. Использовать эту функцию только с положительными значениями нецелесообразно так как это значительно ухудшит результаты вашей нейросети.

Тренировочный сет— это последовательность данных, которыми оперирует нейронная сеть. В нашем случае исключающего или (xor) у нас всего 4 разных исхода то есть у нас будет 4 тренировочных сета: 0xor0=0, 0xor1=1, 1xor0=1,1xor1=0.

Это своеобразный счетчик, который увеличивается каждый раз, когда нейронная сеть проходит один тренировочный сет. Другими словами, это общее количество тренировочных сетов пройденных нейронной сетью.

При инициализации нейронной сети эта величина устанавливается в 0 и имеет потолок, задаваемый вручную. Чем больше эпоха, тем лучше натренирована сеть и соответственно, ее результат. Эпоха увеличивается каждый раз, когда мы проходим весь набор тренировочных сетов, в нашем случае, 4 сетов или 4 итераций.

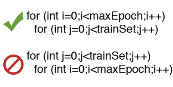

Важно не путать итерацию с эпохой и понимать последовательность их инкремента. Сначала n раз увеличивается итерация, а потом уже эпоха и никак не наоборот. Другими словами, нельзя сначала тренировать нейросеть только на одном сете, потом на другом и т. д. Нужно тренировать каждый сет один раз за эпоху. Так, вы сможете избежать ошибок в вычислениях.

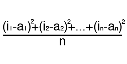

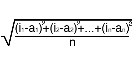

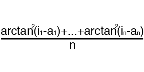

Ошибка— это процентная величина, отражающая расхождение между ожидаемым и полученным ответами. Ошибка формируется каждую эпоху и должна идти на спад. Если этого не происходит, значит, вы что-то делаете не так. Ошибку можно вычислить разными путями, но мы рассмотрим лишь три основных способа: Mean Squared Error (далее MSE), Root MSE и Arctan. Здесь нет какого-либо ограничения на использование, как в функции активации, и вы вольны выбрать любой метод, который будет приносить вам наилучший результат. Стоит лишь учитывать, что каждый метод считает ошибки по-разному. У Arctan, ошибка, почти всегда, будет больше, так как он работает по принципу: чем больше разница, тем больше ошибка. У Root MSE будет наименьшая ошибка, поэтому, чаще всего, используют MSE, которая сохраняет баланс в вычислении ошибки.

MSE

Root MSE

Arctan

Принцип подсчета ошибки во всех случаях одинаков. За каждый сет, мы считаем ошибку, отняв от идеального ответа, полученный. Далее, либо возводим в квадрат, либо вычисляем квадратный тангенс из этой разности, после чего полученное число делим на количество сетов.

Заключение

У нейронных сетей много важных свойств, но ключевое из них — это способность к обучению, на сегодняшний день нейронные сети являются одним из приоритетных направлений исследований в области искусственного интеллекта.

Литература:

- Барский А. Б. Логические нейронные сети. — Изд-во: Бином. Лаборатория знаний, 2007. — 352 с.

- Галушкин А. И. Нейронные сети: основы теории. — Изд-во: Горячая линия — Телеком, 2012. — 496 с.

- Дорогов А. Ю. Теория и проектирование быстрых перестраиваемых преобразований и слабосвязанных нейронных сетей. — Изд-во: Политехника, 2014. — 344 с.

- Злобин В. К., Ручкин В. Н. Нейросети и нейрокомпьютеры. — Изд-во: БХВ-Петербург, 2011. — 256 с.

- Комарцова Л. Г., Максимов А. В. Нейрокомпьютеры. — М.: МГТУ им. Н. Э. Баумана, 2004. — 400 с.

- Тархов Д. А. Нейросетевые модели и алгоритмы / Справочник. — Изд-во: Радиотехника, 2014. — 352 с.

- Хайкин С. Нейронные сети. — Изд-во: Вильямс, 2016. — 1104 с.

- Флах П. Машинное обучение. Наука и искусство построения алгоритмов, которые извлекают знания из данных / Учебник. — Изд-во: ДМК Пресс, 2015. — 400 с.